Содержание

Что такое сжатие без потерь и как оно работает — Журнал «Код»

Мы уже разобрались с тем, как оцифровывается звук. Одна из проблем — если качественно его оцифровывать, то нам нужно очень много данных, а это значит большие файлы, большой расход места на диске, дорогие флешки, много трафика в интернете. Хочется, чтобы файлики были поменьше.

Для этого используется сжатие — различные алгоритмы, которые творят с данными свою магию и на выходе получаются данные меньшего объёма.

Сжатие с потерями и без потерь

Есть два принципиальных вида сжатия — с потерями и без.

Сжатие с потерями означает, что в процессе мы лишились части информации. Алгоритмы сжатия с потерями стараются сделать так, чтобы мы потеряли только те данные, которые нам не слишком важны.

Представьте, что сжатие с потерями — это краткий пересказ произведения из школьной программы: школьнику не так важны описания природы и авторский стиль, ему главное сюжет. Краткий пересказ сохранил только важное, но передал это намного быстрее.

Сжатие без потерь — это когда мы уменьшаем размер файла, при этом не теряя в качестве. Для этого используются интересные математические приёмы и кодирование. Главная мысль — чтобы при раскодировании все данные остались на месте.

Алгоритмы сжатия без потерь

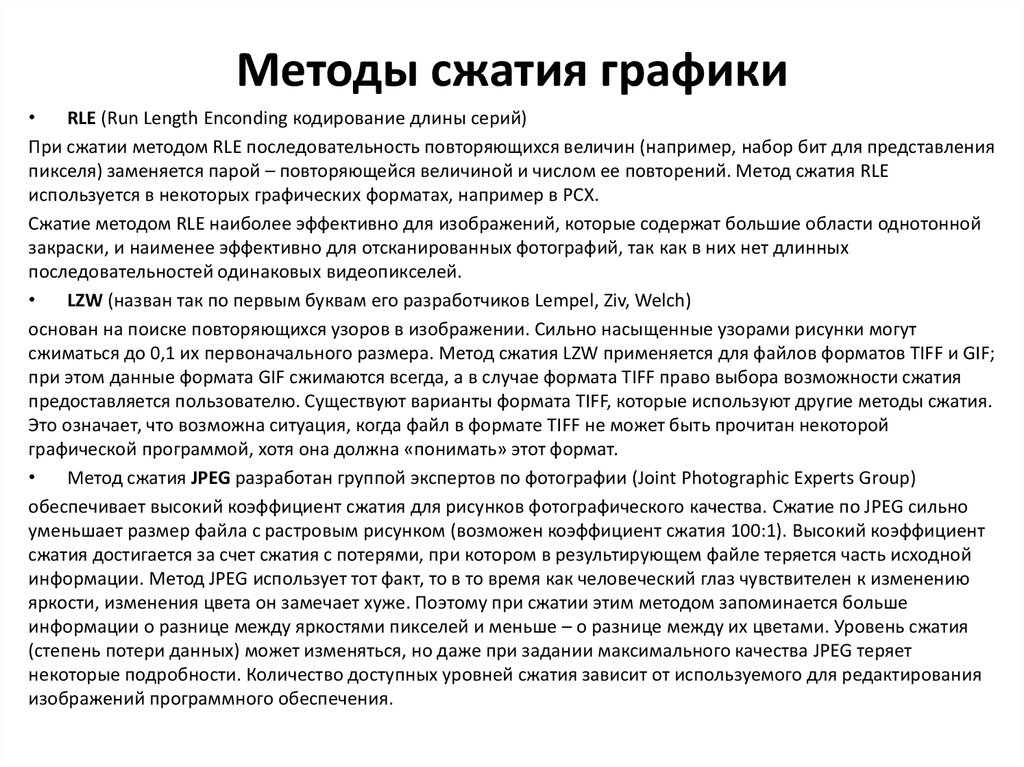

Есть два основных варианта: алгоритм Хаффмана или LZW. LZW используется повсеместно, но объяснить его довольно сложно, он неинтуитивный и требует целой лекции. Гораздо приятнее объяснить алгоритм Хаффмана.

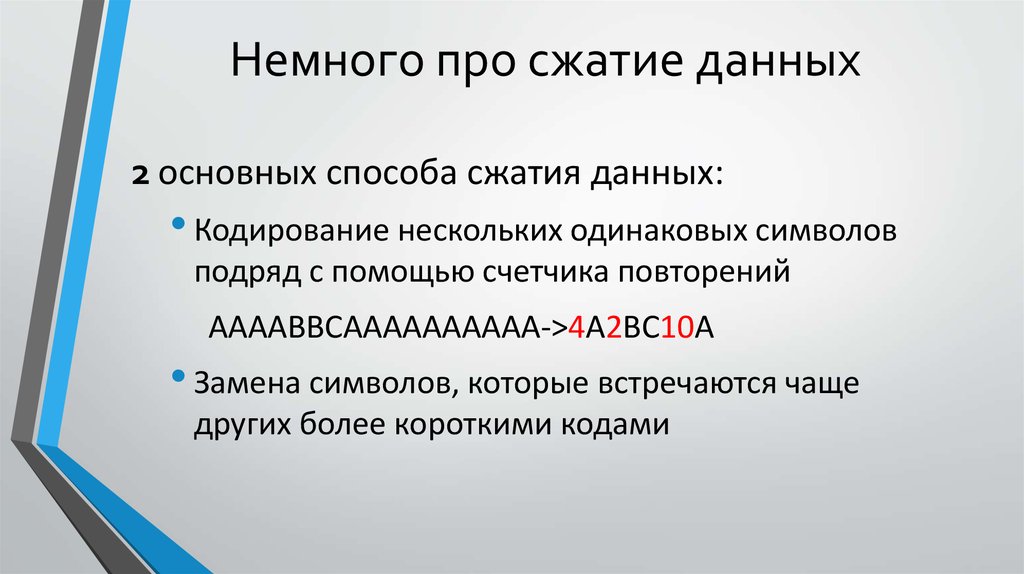

Алгоритм Хаффмана берёт файл, разбивает его на фрагменты, с которыми ему удобно работать, а потом смотрит, насколько часто встречается каждый фрагмент. Самые частые слова этот алгоритм обозначает коротким кодом, а самые редкие — кодом подлиннее. Так как самые частые слова занимают теперь гораздо меньше места, то и готовый файл становится меньше.

Но есть и минус: иногда нужно хранить эту таблицу соответствий слов и кода прямо в этом же файле, а она может сама по себе получиться большой. Чаще всего алгоритм Хаффмана применяется для сжатия текстовых файлов и видео без потерь.

Чаще всего алгоритм Хаффмана применяется для сжатия текстовых файлов и видео без потерь.

Вот пример: берём песню Beyonce — All The Single Ladies. Там есть два таких пассажа:

All the single ladies

All the single ladies

All the single ladies

Now put your hands up

…

If you like it then you shoulda put a ring on it

If you like it then you shoulda put a ring on it

Don’t be mad once you see that he want it

If you like it then you shoulda put a ring on it

Здесь 281 знак. Мы видим, что некоторые строчки повторяются. Закодируем их:

ТАБЛИЦА СЖАТИЯ

\a\ All the single ladies

\b\ Now put your hands up

\c\ If you like it then you shoulda put a ring on it

\d\ Don’t be mad once you see that he want it

ТЕКСТ ПЕСНИ

\a\ \a\ \a\ \b\

…

\c\ \c\ \d\ \c\

Вместе таблицей сжатия этот текст теперь занимает 187 знаков — мы сжали текст почти на треть благодаря тому, что он довольно монотонный.

Сжатие без потерь на примере аудио

В среднем минута несжатого аудио занимает 10 мегабайт. Это довольно много: если у вас, например, часовая запись концерта, то она будет занимать полгигабайта. С другой стороны, в этой записи захвачены все нюансы звука, есть много высоких частот и вообще красота.

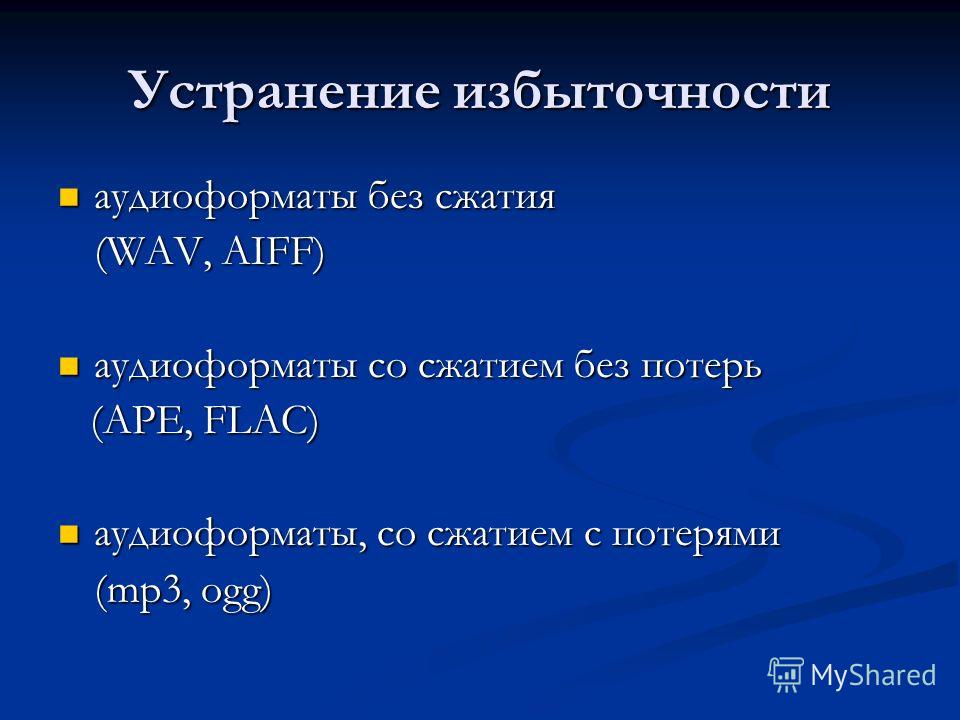

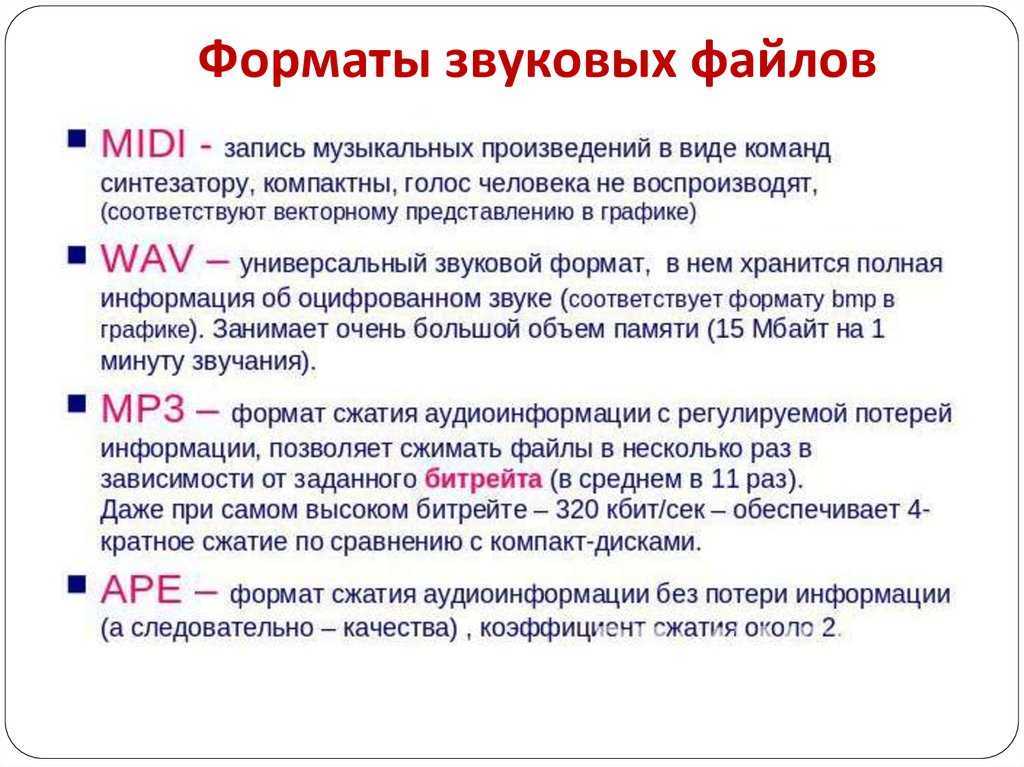

Для таких ситуаций используют сжатие без потерь: оно уменьшает файл в 2–3 раза, не искажая звук. Алгоритмы, которые сжимают аудио, называются кодеками. FLAC и Apple Lossless — два популярных кодека для сжатия аудио без потерь.

Сравните сами размер и качество двухминутного аудио:

Оригинал — без сжатия, формат WAV, 23 мегабайта

Сжатие без потерь — формат FLAC с теми же параметрами, что и WAV, 10 мегабайт

Где ещё применяется сжатие без потерь

В архиваторах. Задача программ-архиваторов — упаковать выбранные файлы так, чтобы архив занимал как можно меньше места, при этом не повреждая то, что внутри. Например, текстовая версия «Войны и мира» может занимать 4 мегабайта, а заархивированная — 100 килобайт, в 40 раз меньше.

Myspace потеряла архивы за 12 лет. Как не потерять свои

В программировании. Есть специальные упаковщики, которые берут готовую программу и оптимизируют код так, чтобы он занимал меньше места, но сохранил свою работоспособность. Например:

- Удаляют комментарии

- Сокращают до минимума названия переменных и функций

- Удаляют символы, которые нужны были человеку для удобочитаемости

Что дальше

В следующей части разберём, как работает сжатие с потерями и почему благодаря этому у нас есть ТикТок и Ютуб.

Сжатие информации без потерь. Часть первая / Хабр

Доброго времени суток.

Сегодня я хочу коснуться темы сжатия данных без потерь. Несмотря на то, что на хабре уже были статьи, посвященные некоторым алгоритмам, мне захотелось рассказать об этом чуть более подробно.

Я постараюсь давать как математическое описание, так и описание в обычном виде, для того, чтобы каждый мог найти для себя что-то интересное.

В этой статье я коснусь фундаментальных моментов сжатия и основных типов алгоритмов.

Сжатие. Нужно ли оно в наше время?

Разумеется, да. Конечно, все мы понимаем, что сейчас нам доступны и носители информации большого объема, и высокоскоростные каналы передачи данных. Однако, одновременно с этим растут и объемы передаваемой информации. Если несколько лет назад мы смотрели 700-мегабайтные фильмы, умещающиеся на одну болванку, то сегодня фильмы в HD-качестве могут занимать десятки гигабайт.

Конечно, пользы от сжатия всего и вся не так много. Но все же существуют ситуации, в которых сжатие крайне полезно, если не необходимо.

- Пересылка документов по электронной почте (особенно больших объемов документов с использованием мобильных устройств)

- При публикации документов на сайтах, потребность в экономии трафика

- Экономия дискового пространства в тех случаях, когда замена или добавление средств хранения затруднительно.

Например, подобное бывает в тех случаях, когда выбить бюджет под капитальные расходы непросто, а дискового пространства не хватает

Например, подобное бывает в тех случаях, когда выбить бюджет под капитальные расходы непросто, а дискового пространства не хватает

Конечно, можно придумать еще множество различных ситуаций, в которых сжатие окажется полезным, но нам достаточно и этих нескольких примеров.

Все методы сжатия можно разделить на две большие группы: сжатие с потерями и сжатие без потерь. Сжатие без потерь применяется в тех случаях, когда информацию нужно восстановить с точностью до бита. Такой подход является единственно возможным при сжатии, например, текстовых данных.

В некоторых случаях, однако, не требуется точного восстановления информации и допускается использовать алгоритмы, реализующие сжатие с потерями, которое, в отличие от сжатия без потерь, обычно проще реализуется и обеспечивает более высокую степень архивации.

| Сжатие с потерями |

Лучшие степени сжатия, при сохранении «достаточно хорошего» качества данных. Применяются в основном для сжатия аналоговых данных — звука, изображений. В таких случаях распакованный файл может очень сильно отличаться от оригинала на уровне сравнения «бит в бит», но практически неотличим для человеческого уха или глаза в большинстве практических применений. В таких случаях распакованный файл может очень сильно отличаться от оригинала на уровне сравнения «бит в бит», но практически неотличим для человеческого уха или глаза в большинстве практических применений. |

| Сжатие без потерь |

| Данные восстанавливаются с точностью до бита, что не приводит к каким-либо потерям информации. Однако, сжатие без потерь показывает обычно худшие степени сжатия. |

Итак, перейдем к рассмотрению алгоритмов сжатия без потерь.

Универсальные методы сжатия без потерь

В общем случае можно выделить три базовых варианта, на которых строятся алгоритмы сжатия.

Первая группа методов – преобразование потока. Это предполагает описание новых поступающих несжатых данных через уже обработанные. При этом не вычисляется никаких вероятностей, кодирование символов осуществляется только на основе тех данных, которые уже были обработаны, как например в LZ – методах (названных по имени Абрахама Лемпеля и Якоба Зива). В этом случае, второе и дальнейшие вхождения некой подстроки, уже известной кодировщику, заменяются ссылками на ее первое вхождение.

В этом случае, второе и дальнейшие вхождения некой подстроки, уже известной кодировщику, заменяются ссылками на ее первое вхождение.

Вторая группа методов – это статистические методы сжатия. В свою очередь, эти методы делятся на адаптивные (или поточные), и блочные.

В первом (адаптивном) варианте, вычисление вероятностей для новых данных происходит по данным, уже обработанным при кодировании. К этим методам относятся адаптивные варианты алгоритмов Хаффмана и Шеннона-Фано.

Во втором (блочном) случае, статистика каждого блока данных высчитывается отдельно, и добавляется к самому сжатому блоку. Сюда можно отнести статические варианты методов Хаффмана, Шеннона-Фано, и арифметического кодирования.

Третья группа методов – это так называемые методы преобразования блока. Входящие данные разбиваются на блоки, которые затем трансформируются целиком. При этом некоторые методы, особенно основанные на перестановке блоков, могут не приводить к существенному (или вообще какому-либо) уменьшению объема данных. Однако после подобной обработки, структура данных значительно улучшается, и последующее сжатие другими алгоритмами проходит более успешно и быстро.

Однако после подобной обработки, структура данных значительно улучшается, и последующее сжатие другими алгоритмами проходит более успешно и быстро.

Общие принципы, на которых основано сжатие данных

Все методы сжатия данных основаны на простом логическом принципе. Если представить, что наиболее часто встречающиеся элементы закодированы более короткими кодами, а реже встречающиеся – более длинными, то для хранения всех данных потребуется меньше места, чем если бы все элементы представлялись кодами одинаковой длины.

Точная взаимосвязь между частотами появления элементов, и оптимальными длинами кодов описана в так называемой теореме Шеннона о источнике шифрования(Shannon’s source coding theorem), которая определяет предел максимального сжатия без потерь и энтропию Шеннона.

Немного математики

Если вероятность появления элемента si равна p(si), то наиболее выгодно будет представить этот элемент — log2p(si) битами. Если при кодировании удается добиться того, что длина всех элементов будет приведена к log2p(si) битам, то и длина всей кодируемой последовательности будет минимальной для всех возможных методов кодирования. При этом, если распределение вероятностей всех элементов F = {p(si)} неизменно, и вероятности элементов взаимно независимы, то средняя длина кодов может быть рассчитана как

Если при кодировании удается добиться того, что длина всех элементов будет приведена к log2p(si) битам, то и длина всей кодируемой последовательности будет минимальной для всех возможных методов кодирования. При этом, если распределение вероятностей всех элементов F = {p(si)} неизменно, и вероятности элементов взаимно независимы, то средняя длина кодов может быть рассчитана как

Это значение называют энтропией распределения вероятностей F, или энтропией источника в заданный момент времени.

Однако обычно вероятность появления элемента не может быть независимой, напротив, она находится в зависимости от каких-то факторов. В этом случае, для каждого нового кодируемого элемента si распределение вероятностей F примет некоторое значение Fk, то есть для каждого элемента F= Fk и H= Hk.

Иными словами, можно сказать, что источник находится в состоянии k, которому соответствует некий набор вероятностей pk(si) для всех элементов si.

Поэтому, учитывая эту поправку, можно выразить среднюю длину кодов как

Где Pk — вероятность нахождения источника в состоянии k.

Итак, на данном этапе мы знаем, что сжатие основано на замене часто встречающихся элементов короткими кодами, и наоборот, а так же знаем, как определить среднюю длину кодов. Но что же такое код, кодирование, и как оно происходит?

Кодирование без памяти

Коды без памяти являются простейшими кодами, на основе которых может быть осуществлено сжатие данных. В коде без памяти каждый символ в кодируемом векторе данных заменяется кодовым словом из префиксного множества двоичных последовательностей или слов.

На мой взгляд, не самое понятное определение. Рассмотрим эту тему чуть более подробно.

Пусть задан некоторый алфавит , состоящий из некоторого (конечного) числа букв. Назовем каждую конечную последовательность символов из этого алфавита (A=a1, a2,… ,an) словом, а число n — длиной этого слова.

Пусть задан также другой алфавит. Аналогично, обозначим слово в этом алфавите как B.

Введем еще два обозначения для множества всех непустых слов в алфавите. Пусть — количество непустых слов в первом алфавите, а — во втором.

Пусть также задано отображение F, которое ставит в соответствие каждому слову A из первого алфавита некоторое слово B=F(A) из второго. Тогда слово B будет называться кодом слова A, а переход от исходного слова к его коду будет называться кодированием.

Поскольку слово может состоять и из одной буквы, то мы можем выявить соответствие букв первого алфавита и соответствующих им слов из второго:

a1 <-> B1

a2 <-> B2

…

an <-> Bn

Это соответствие называют схемой, и обозначают ∑.

В этом случае слова B1, B2,…, Bn называют элементарными кодами, а вид кодирования с их помощью — алфавитным кодированием. Конечно, большинство из нас сталкивались с таким видом кодирования, пусть даже и не зная всего того, что я описал выше.

Конечно, большинство из нас сталкивались с таким видом кодирования, пусть даже и не зная всего того, что я описал выше.

Итак, мы определились с понятиями алфавит, слово, код, и кодирование. Теперь введем понятие префикс.

Пусть слово B имеет вид B=B’B». Тогда B’ называют началом, или префиксом слова B, а B» — его концом. Это довольно простое определение, но нужно отметить, что для любого слова B, и некое пустое слово ʌ («пробел»), и само слово B, могут считаться и началами и концами.

Итак, мы подошли вплотную к пониманию определения кодов без памяти. Последнее определение, которое нам осталось понять — это префиксное множество. Схема ∑ обладает свойством префикса, если для любых 1≤i, j≤r, i≠j, слово Bi не является префиксом слова Bj.

Проще говоря, префиксное множество – это такое конечное множество, в котором ни один элемент не является префиксом (или началом) любого другого элемента. Простым примером такого множества является, например, обычный алфавит.

Итак, мы разобрались с основными определениями. Так как же происходит само кодирование без памяти?

Оно происходит в три этапа.

- Составляется алфавит Ψ символов исходного сообщения, причем символы алфавита сортируются по убыванию их вероятности появления в сообщении.

- Каждому символу ai из алфавита Ψ ставится в соответствие некое слово Bi из префиксного множества Ω.

- Осуществляется кодирование каждого символа, с последующим объединением кодов в один поток данных, который будет являться результатам сжатия.

Одним из канонических алгоритмов, которые иллюстрируют данный метод, является алгоритм Хаффмана.

Алгоритм Хаффмана

Алгоритм Хаффмана использует частоту появления одинаковых байт во входном блоке данных, и ставит в соответствие часто встречающимся блокам цепочки бит меньшей длины, и наоборот. Этот код является минимально – избыточным кодом. Рассмотрим случай, когда, не зависимо от входного потока, алфавит выходного потока состоит из всего 2 символов – нуля и единицы.

Рассмотрим случай, когда, не зависимо от входного потока, алфавит выходного потока состоит из всего 2 символов – нуля и единицы.

В первую очередь при кодировании алгоритмом Хаффмана, нам нужно построить схему ∑. Делается это следующим образом:

- Все буквы входного алфавита упорядочиваются в порядке убывания вероятностей. Все слова из алфавита выходного потока (то есть то, чем мы будем кодировать) изначально считаются пустыми (напомню, что алфавит выходного потока состоит только из символов {0,1}).

- Два символа aj-1 и aj входного потока, имеющие наименьшие вероятности появления, объединяются в один «псевдосимвол» с вероятностью p равной сумме вероятностей входящих в него символов. Затем мы дописываем 0 в начало слова Bj-1, и 1 в начало слова Bj, которые будут впоследствии являться кодами символов aj-1 и aj соответственно.

- Удаляем эти символы из алфавита исходного сообщения, но добавляем в этот алфавит сформированный псевдосимвол (естественно, он должен быть вставлен в алфавит на нужное место, с учетом его вероятности).

Шаги 2 и 3 повторяются до тех пор, пока в алфавите не останется только 1 псевдосимвол, содержащий все изначальные символы алфавита. При этом, поскольку на каждом шаге и для каждого символа происходит изменение соответствующего ему слова Bi (путем добавление единицы или нуля), то после завершения этой процедуры каждому изначальному символу алфавита ai будет соответствовать некий код Bi.

Для лучшей иллюстрации, рассмотрим небольшой пример.

Пусть у нас есть алфавит, состоящий из всего четырех символов — { a1, a2, a3, a4}. Предположим также, что вероятности появления этих символов равны соответственно p1=0.5; p2=0.24; p3=0.15; p4=0.11 (сумма всех вероятностей, очевидно, равна единице).

Итак, построим схему для данного алфавита.

- Объединяем два символа с наименьшими вероятностями (0.11 и 0.

15) в псевдосимвол p’.

15) в псевдосимвол p’. - Удаляем объединенные символы, и вставляем получившийся псевдосимвол в алфавит.

- Объединяем два символа с наименьшей вероятностью (0.24 и 0.26) в псевдосимвол p».

- Удаляем объединенные символы, и вставляем получившийся псевдосимвол в алфавит.

- Наконец, объединяем оставшиеся два символа, и получаем вершину дерева.

Если сделать иллюстрацию этого процесса, получится примерно следующее:

Как вы видите, при каждом объединении мы присваиваем объединяемым символам коды 0 и 1.

Таким образом, когда дерево построено, мы можем легко получить код для каждого символа. В нашем случае коды будут выглядить так:

a1 = 0

a2 = 11

a3 = 100

a4 = 101

Поскольку ни один из данных кодов не является префиксом какого-нибудь другого (то есть, мы получили пресловутое префиксное множество), мы можем однозначно определить каждый код в выходном потоке.

Итак, мы добились того, что самый частый символ кодируется самым коротким кодом, и наоборот.

Если предположить, что изначально для хранения каждого символа использовался один байт, то можно посчитать, насколько нам удалось уменьшить данные.

Пусть на входу у нас была строка из 1000 символов, в которой символ a1 встречался 500 раз, a2 — 240, a3 — 150, и a4 — 110 раз.

Изначально данная строка занимала 8000 бит. После кодирования мы получим строку длинной в ∑pili = 500 * 1 + 240 * 2 + 150 * 3 + 110 * 3 = 1760 бит. Итак, нам удалось сжать данные в 4,54 раза, потратив в среднем 1,76 бита на кодирование каждого символа потока.

Напомню, что согласно Шеннону, средняя длина кодов составляет . Подставив в это уравнение наши значения вероятностей, мы получим среднюю длину кодов равную 1.75496602732291, что весьма и весьма близко к полученному нами результату.

Тем не менее, следует учитывать, что помимо самих данных нам необходимо хранить таблицу кодировки, что слегка увеличит итоговый размер закодированных данных. Очевидно, что в разных случаях могут с использоваться разные вариации алгоритма – к примеру, иногда эффективнее использовать заранее заданную таблицу вероятностей, а иногда – необходимо составить ее динамически, путем прохода по сжимаемым данным.

Очевидно, что в разных случаях могут с использоваться разные вариации алгоритма – к примеру, иногда эффективнее использовать заранее заданную таблицу вероятностей, а иногда – необходимо составить ее динамически, путем прохода по сжимаемым данным.

Заключение

Итак, в этой статье я постарался рассказать об общих принципах, по которым происходит сжатие без потерь, а также рассмотрел один из канонических алгоритмов — кодирование по Хаффману.

Если статья придется по вкусу хабросообществу, то я с удовольствием напишу продолжение, так как есть еще множество интересных вещей, касающихся сжатия без потерь; это как классические алгоритмы, так и предварительные преобразования данных (например, преобразование Барроуза-Уилира), ну и, конечно, специфические алгоритмы для сжатия звука, видео и изображений (самая, на мой взгляд, интересная тема).

Литература

- Ватолин Д., Ратушняк А., Смирнов М. Юкин В. Методы сжатия данных.

Устройство архиваторов, сжатие изображений и видео; ISBN 5-86404-170-X; 2003 г.

Устройство архиваторов, сжатие изображений и видео; ISBN 5-86404-170-X; 2003 г. - Д. Сэломон. Сжатие данных, изображения и звука; ISBN 5-94836-027-Х; 2004г.

- www.wikipedia.org

Zip-файлов без сжатия — Суперпользователь

спросил

Изменено

12 месяцев назад

Просмотрено

64к раз

Я хочу объединить несколько больших файлов в один файл, чтобы упростить их совместное использование. Файлы уже сжаты (например, jpeg, видео и т. д.), поэтому мне не нужно сжатие, только архивирование. Как я могу поместить их в zip-файл без использования функции сжатия zip? Я не хочу тратить время, пытаясь сжать гигабайты уже сжатых файлов.

Я хочу использовать файл zip, а не файл tar , потому что многие пользователи Windows не могут открыть эти файлы.

- компрессионный

- молния

2

Формат ZIP всегда поддерживал архивирование файлов с нулевой степенью сжатия, даже начиная с pkzip / pkunzip во времена DOS.

В настоящее время почти все программы сжатия поддерживают это; 7-Zip — один из них, он позволяет указать степень сжатия как из графического интерфейса, так и из командной строки, и он бесплатный.

3

Для Linux эта команда оболочки заархивирует папку mydir без сжатия:

zip -0 -r mydir.zip mydir

Если вы используете WinZip

Перейдите на ленту «Настройки» и найдите группу «zip»:

После перетащите файлы, которые вы хотите заархивировать, в область файлов.

Всплывающее окно показывает, что файлы не были сжаты по размеру:

ZIP-архив Info-ZIP с открытым исходным кодом, бесплатный и уже установленный в большинстве Unixish-систем имеет параметр «-0» только для хранения.

Также, если вы просто заархивируете любым архиватором, и записи будут храниться короче, чем сжатые, что происходит с уже сжатыми файлами, тогда они будут сохранены автоматически. Однако, если вы уже знаете, что они сжаты, то быстрее просто указать zip с -0.

Щелкните правой кнопкой мыши все файлы, которые вы хотите заархивировать, в меню выберите «Отправить», затем нажмите «Сжатый файл».

4

Почти все современные инструменты сжатия обнаруживают, что файлы уже сжаты, и предпочитают не сжимать такие файлы.

Вы также можете использовать B1 Free Archiver — он отлично поддерживает формат zip.

После нажатия «Создать архив» просто нажмите кнопку «Дополнительные параметры» и выберите «Сохранить». Он сохраняет файлы только как один файл, не сжимая их.

Используя команду zip, вы можете предоставить определенный список расширений для хранения без сжатия. Таким образом, вы не тратите время (повторно) на сжатие медиафайлов, но при этом получаете преимущества сжатия необработанных файлов в том же архиве.

Флаг -n и принимает список расширений, разделенных двоеточиями. Например.

zip -n .gz:.mp4:.jpg -r mydir.zip мой каталог

Существует список сохраненных файлов по умолчанию; в соответствии с справочной страницей моего Linux-бокса:

По умолчанию zip не сжимает файлы с расширениями в списке .Z:.zip:.zoo:.arc:.lzh:.arj

Вы также можете указать новый список по умолчанию, используя переменную среды ZIPOPT . Например, под bash:

экспорт ZIPOPT="-n .gz:.mp4:.jpg:.zip:.gif"

Чтобы полностью отключить это поведение, включая список расширений по умолчанию, используйте пустой список, состоящий из двоеточия: zip -n : -r ... .

Зарегистрируйтесь или войдите в систему

Зарегистрируйтесь с помощью Google

Зарегистрироваться через Facebook

Зарегистрируйтесь, используя адрес электронной почты и пароль

Опубликовать как гость

Электронная почта

Обязательно, но не отображается

Опубликовать как гость

Электронная почта

Требуется, но не отображается

Нажимая «Опубликовать свой ответ», вы соглашаетесь с нашими условиями обслуживания, политикой конфиденциальности и политикой использования файлов cookie

7 zip — Как сделать «Файлы хранить без сжатия» в 7-zip?

спросил

Изменено

5 лет, 5 месяцев назад

Просмотрено

66 тысяч раз

Есть ли способ выборочно предотвращать определенные типы файлов от сжатия в 7-zip, как в WinRAR?

Я пытаюсь сжать огромную папку (много гигабайт), и я не хочу повторно сжимать уже сжатые файлы (например, ZIP-файлы) — их следует хранить без сжатия.

- компрессионный

- 7-zip

3

Да, в одном архиве 7-Zip можно использовать разные методы сжатия для разных файлов.

Используйте версию 7-Zip для командной строки с параметром -m , чтобы указать метод как Копировать , что означает отсутствие сжатия.

Пример:

7za a -m0=Копировать tmp7.7z *.txt

Дополнительные сведения см. в разделе Переключатель -m (установить метод сжатия).

2

Предположим, у вас есть zip-файлы и несжатые txt-файлы в папке.

Первым шагом является создание архива, сжимающего текстовые файлы, с помощью следующей команды.

вы можете использовать -m для установки уровней сжатия, это также зависит от метода сжатия, который вы используете

Предположим, здесь используется только сжатие по умолчанию

7z a сжатый.7z *.txt -r

Сейчас вы получите сжатый .7z.

Вторым шагом будет копирование уже сжатого файла в этот архив или создание нового архива

7z u сжатый.7z -u!update.7z -mx0 *.zip

Здесь более подробно описана команда обновления

А если у вас есть возможность использовать графический интерфейс, то обновление можно сделать следующим образом

1

Технически сжатые файлы больше не сжимаются, что-то насчет предела энтропии или чего-то подобного, я забыл детали, но самое большее, что вы когда-либо получали, это менее 2%, которые я видел.

Большинство хороших компрессоров проверяют сжатие и просто сохраняют несжимаемые файлы, поскольку последующее сжатие увеличивает нагрузку и увеличивает размер.

Конечно, в первую очередь это работа и время просмотра файла.

Как обсуждалось в других ответах, выполнение нескольких проходов по вашему набору файлов, вероятно, будет лучшим решением, и его легко использовать в сценариях.

Например, подобное бывает в тех случаях, когда выбить бюджет под капитальные расходы непросто, а дискового пространства не хватает

Например, подобное бывает в тех случаях, когда выбить бюджет под капитальные расходы непросто, а дискового пространства не хватает

15) в псевдосимвол p’.

15) в псевдосимвол p’. Устройство архиваторов, сжатие изображений и видео; ISBN 5-86404-170-X; 2003 г.

Устройство архиваторов, сжатие изображений и видео; ISBN 5-86404-170-X; 2003 г. 7z *.txt -r

7z *.txt -r